Bilgisayarların sadece komutları izlediği durağan yazılım çağı yerini, fiziksel dünyayı kavrayan ve otonom kararlar verebilen “akıl yürütme” mimarilerine bıraktığı tarihi bir kırılma noktasındayız. 1956 Dartmouth Konferansı’nın teorik düşlerinden, bugün Manus AI gibi hata payını %90 azaltan ajanik sistemlere uzanan bu evrim, sadece hızı değil zekanın birim maliyetini de kökten değiştiriyor. Bu rehberde, GPU devriminden Transformer mimarisine, MoE verimliliğinden AGI vizyonuna kadar yapay zekanın 70 yıllık teknolojik DNA’sını ve geleceğin otonom ekonomisindeki konumunuzu stratejik bir derinlikle analiz ediyoruz.

Video Özet:

1. Yapay Zekanın Evrimi: İlk Adımlar ve Temeller

Günümüzde hayatımızın her alanına dokunan teknolojilerin temelinde, yapay zekanın evrimi yatıyor. Bu süreç, sadece modern laboratuvarlarda değil, on yıllar önce atılan vizyoner adımlarla başladı. Bilgisayarların karmaşık sorunları çözme yeteneği, aniden ortaya çıkan bir sıçrama değil; sistematik bir mühendislik birikiminin sonucudur. Bu uzun soluklu yolculuğu anlamak, gelecekteki yapay zeka tabanlı sistemlerin nereye varacağını öngörmemizi sağlıyor. Mevcut verilere göre, algoritmik düşüncenin temelleri 20. yüzyılın ortalarına kadar uzanıyor. İnsanların makinelerle kurduğu etkileşimin ilk kıvılcımları, aslında basit ama sarsıcı felsefi sorularla atıldı.

Teknoloji dünyasında sınırların yeniden çizildiği bu dönem, donanımın ötesinde büyük bir fikir sıçraması gerektiriyordu. Makinelerin otonom kararlar verebilen yapılara dönüşmesi fikri, dönemin bilim insanları için oldukça büyüleyici bir hedefti. Sınırlı örneklemde yapılan ilk teorik çalışmalar, yazılım ve donanım arasındaki ilişkinin yeniden tanımlanmasına yol açtı. Bu sayede, geleceğin akıllı asistanlarının ve otonom arayüzlerinin temel mantık mimarisi daha o günlerden itibaren yavaş yavaş şekillenmeye başladı.

Yapay Zekanın Evrimi ve Alan Turing Vizyonu

Turing’in “Makineler düşünebilir mi?” sorusu, teknoloji ekosisteminde yepyeni bir sayfa açtı. 1950 yılında yayımlanan ufuk açıcı makalesi, makinelerin insan zekasını taklit edip edemeyeceğini sistemli bir şekilde sorguluyordu. Bu tartışma, günümüzde Turing Testi olarak bilinen Taklit Oyunu kavramını teknoloji literatürüne kazandırdı. Başlangıçta zihinsel bir egzersiz gibi görünen bu test, yıllar içinde makine öğrenimi performansının temel kriterlerinden biri haline geldi. O günün donanımları saniyede sadece sınırlı işlem yapabilirken, Turing’in ortaya koyduğu vizyon bugünün devasa veri merkezlerinin yol haritasını önden çizmiş oldu.

Bu aşamada, teknoloji tarihi açısından geri dönülemez bir mantıksal eşik aşıldı ve yapay zekanın evrimi ivme kazandı. Makinelerin mantıksal kararlar verebileceği fikri, somut bir hedef olarak laboratuvarlara taşındı. Ön bulgulara göre, insan ve makine etkileşimini bir perde arkasından test etme konsepti, donanım sistemlerinin ne kadar inandırıcı olabileceğini ölçmek için güvenilir bir zemin sağladı. İnsana en doğal gelen arayüzlerin ilk temelleri doğrudan bu geniş felsefeyle kurgulandı.

Dartmouth Konferansı ve İlk Resmi Temeller

Alan Turing’in attığı kavramsal tohumlar, 1956 yılında Dartmouth Konferansı ile resmi bir akademik disipline evrildi. John McCarthy, Marvin Minsky ve Claude Shannon gibi araştırmacılar, bir araya gelerek yepyeni bir teknoloji vizyonu oluşturdular. Rapor bulgularına göre, bu tarihi zirve, makinelerin dili aktif kullanabileceği ve insanlara özgü soyut kavramları öğrenebileceği varsayımı üzerine inşa edildi. Konferansın temel hedefi, her zeka belirtisinin bir makine tarafından başarıyla simüle edilebilir olduğu tezini akademik platformda kalıcı olarak kanıtlamaktı.

O yıllarda akademisyenler, makine zekasında kısa sürede kalıcı bir sıçrama yaşanacağına içtenlikle inanıyordu. Başlangıçtaki bu iyimser yaklaşım, yazılım mimarilerinin ilk taslaklarının kodlanmasını sağladı. Algoritmik mantığın sistemlere entegre edilmesi konusunda atılan erken adımlar, endüstri içindeki beklentileri de oldukça yukarı taşıdı (Kaynak: Dartmouth AI Archive). Oluşturulan bu ilk çerçeveler, makinelerin devasa verilerle kendi başlarına öğrenebilen değil, belirlenen kısıtlı kuralları uygulayan sadık yürütücüler olması esasına dayanıyordu.

Sembolik YZ ve Logic Theorist Programı

Konferansın hemen ardından, Sembolik YZ olarak adlandırılan kural tabanlı algoritmik sistemler bilim dünyasında ön plana çıktı. Bu dönemin en dikkat çekici mühendislik ürünlerinden biri olan Logic Theorist, karmaşık matematiksel teoremleri ispatlayabilen ilk yazılım olarak tarihe geçti. Erken dönem testlere göre, bu yazılım sorunları insan benzeri bir akıl yürütme süreciyle, tamamen önceden tanımlanmış katı kurallar çerçevesinde adım adım çözebiliyordu. Sistem, tümdengelim yöntemini aktif kullanarak zayıf olasılıkları eliyor ve nihai mantıksal sonuca ulaşıyordu.

Ön bulgulara göre, yapay zekanın evrimi içindeki bu ilk sembolik uygulamalar, makinelerin sadece sayısal verileri değil, sembolik kavramları da işleyebileceğini endüstriye kanıtladı. Ancak bu sistemler, belirlenmiş kurallara körü körüne bağlı çalıştıkları için belirsizlik içeren günlük senaryolarda tıkanmaya mahkumdu. Günümüz sinir ağları gibi milyarlarca parametre üzerinden esnek şekilde öğrenmek yerine, doğrudan programcının manuel kodladığı mantık ağaçlarına bağımlı kalmaları, operasyonel sınırları ciddi şekilde daraltıyordu.

Yapay Zekanın Evrimi: İlk Kış ve Duraklama

1970’lere gelindiğinde, yapay zekanın evrimi dönemin teknolojik donanımlarının getirdiği devasa fiziksel sınırlara çarptı. İlk dönemdeki aşırı iyimserlik, algoritmaların pratik dünyadaki karmaşık problemleri makul sürelerde çözememesi nedeniyle yerini derin bir hayal kırıklığına bıraktı. 1973 yılında yayımlanan kapsamlı Lighthill Raporu, laboratuvar araştırmalarının vaat edilen ekonomik sonuçları veremediğini açıkça ortaya koydu (Kaynak: UK Science Research Council). Bu kritik durum tespitinin hemen ardından, birçok ülkede yenilikçi projelere sağlanan devlet fonları büyük oranda kesildi.

Akademik literatürde “İlk YZ Kışı” olarak adlandırılan bu dramatik süreç, teknolojik yatırımların neredeyse durduğu ve büyük araştırmaların rafa kaldırıldığı durağan bir evreydi. Rapor bulgularına göre, mevcut bilgisayarların işlem gücü ve veri depolama kapasiteleri, hayal edilen akıllı sistemleri çalıştırmak için fiziksel olarak son derece yetersizdi. Bu kriz bilişim sektörünü pazar gerçekleriyle yüzleştirirken, uzun vadede daha ulaşılabilir ölçülebilir hedeflerin konulmasına zemin hazırladı (Kaynak: Gartner Research Archive). Yaşanan bu dönüm noktası, gelecekte istatistiksel öğrenme modellerine geçişin en güçlü tetikleyicisi oldu.

2. Yapay Zekanın Evrimi: GPU ve Transformer Çağı

Yapay zekanın evrimi, karmaşık matematiksel hesaplamalardan çıkarak günlük hayatımızı şekillendiren pratik bir araca dönüşme sürecini temsil ediyor. Geçmişte laboratuvar duvarları arasına sıkışan kural tabanlı sistemler, günümüzde devasa veri merkezlerinde işlenerek akıllı asistanlara ve yaratıcı platformlara güç veriyor. Bu devasa sıçrama, sadece daha hızlı işlemcilerin değil, algoritmaların dünyayı algılama biçimindeki köklü değişimlerin bir sonucudur.

Yapay Zekanın Evrimi ve Nöral Ağların Uyanışı

1980’li yıllarda sembolik yaklaşımlar, yani her kuralın insan eliyle koda döküldüğü sistemler, gerçek dünyanın karmaşıklığı karşısında hantal kalmaya başlamıştı. Örneğin, bir bilgisayara görseldeki nesneleri kurallarla anlatmak neredeyse imkansızdı. Bu çıkmaz, araştırmacıları insan beyninin çalışma prensibini taklit eden bağlantıcılık yaklaşımına yöneltti.

Bu dönemde araştırmacılar, nöral ağların kendi hatalarını fark edip düzeltmesini sağlayan Geri Yayılım algoritmasını geliştirerek yapay zekanın evrimi için yeni bir dönem başlattı (Nature Araştırma Raporu). Önceki nesil kuralcı algoritmalar yeni durumlara uyum sağlayamazken, bu yeni yaklaşım hataları geriye doğru analiz ederek kendini eğitmeyi başardı.

Bu kritik gelişme, modern derin öğrenme sistemlerinin sağlam bir temel üzerine inşa edilmesini sağladı. İnsan beynindeki nöronlar gibi birbirine bağlanan yapay düğümler, bilgiyi statik kurallar yerine dinamik ağırlıklarla işlemeye başladı.

AlexNet Momenti ve GPU Devrimi

Uzun bir kuluçka döneminin ardından 2012 yılı, bu alanda adeta bir patlama noktası yaratarak yapay zekanın evrimi sürecini hızlandırdı. Geleneksel işlemcilerin yetersiz kaldığı büyük hesaplamalar için grafik işlem birimleri (GPU) devreye girdi. Geliştirilen AlexNet modeli, popüler bir görsel tanıma yarışmasında hata payını önceki nesillerdeki %26 seviyesinden yaklaşık %15.3 seviyesine indirerek ezber bozdu (ImageNet 2012 Kayıtları).

Bu çarpıcı başarı, milyarlarca işlemi aynı anda yapabilen GPU’ların akıllı sistemler için ne kadar hayati olduğunu kanıtladı. Ekran kartları, yapıları gereği aynı anda binlerce küçük işlemi paralel olarak yürütebilecek şekilde tasarlanmıştır. Bu donanım avantajıyla birlikte algoritmaların eğitim süresi aylardan haftalara düştü.

Veriyi paralel olarak işleyebilen bu donanımlar, daha derin ve çok katmanlı ağların kurulmasına olanak tanıdı. Teknoloji devleri, yatırımlarını kural tabanlı sistemlerden hızla GPU tabanlı derin öğrenme mimarilerine kaydırdı.

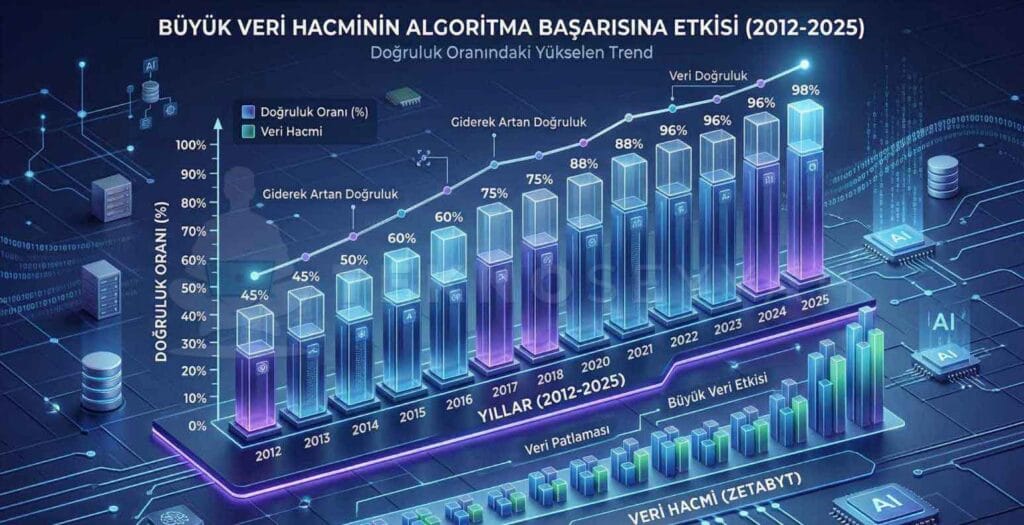

Verinin Gücü: Yapay Zekanın Evrimi Sürecinde Yeni Petrol

İnternet kullanımının geniş kitlelere yayılmasıyla birlikte dijital dünyada oluşan devasa veri yığınları, zeki algoritmaların ana yakıtı haline geldi. Akıllı sistemler, ne kadar çok çeşitli veriyle beslenirse o kadar isabetli ve doğal kararlar alabiliyor. Bu durum, devasa veri setlerini aşırı güçlü donanımlarla işleme mantığının zekayı taklit etmedeki önemini ortaya koydu.

Rapor bulgularına göre, sisteme beslenen veri miktarındaki her büyük artış, algoritmaların tahmin doğruluğunu istikrarlı bir şekilde yukarı taşıyor (McKinsey Büyük Veri Analizi). Günümüzde modern bir algoritma, internet üzerindeki milyonlarca makale ve tartışma üzerinden eğitilerek bağlamı detaylı bir şekilde öğreniyor.

Gündelik hayatta sıkça başvurduğumuz gelişmiş çeviri uygulamaları, bu veri odaklı gücün birer ürünü olarak karşımıza çıkıyor. Böylece yapay zekanın evrimi, yalnızca teorik bir çerçeve olmaktan çıkıp son kullanıcıya doğrudan dokunan bir teknolojiye dönüştü.

2017 Transformer Devrimi ve Dikkat Mekanizması

2017 yılında yayımlanan yenilikçi bir makale, dil modellerinin çalışma prensibini kökten değiştirerek yapay zekanın evrimi için yeni bir kilometre taşı oluşturdu. Geleneksel Yinelemeli Sinir Ağları (RNN), uzun metinleri işlerken kelimeleri tek tek okuduğu için başlangıçtaki bağlamı unutma sorunu yaşıyordu. Yeni geliştirilen Transformer mimarisi ise sunduğu dikkat mekanizması sayesinde bir cümledeki tüm kelimelere aynı anda odaklanmayı başardı.

Bu teknolojik sıçrama, kelimeler arasındaki ilişkileri eşzamanlı olarak ağırlıklandırarak bütünsel bir anlama kapasitesi sundu. Önceki sistemler kısa paragraflarda bile zorlanırken, Transformer mimarisi yüzlerce sayfalık karmaşık dokümanlarda ana fikri kaybetmeden bağlam kurabiliyor. Böylece veri işleme süreleri dramatik bir şekilde kısalırken verimlilik en üst seviyeye çıktı.

Büyük Dil Modelleri ve Yapay Zekanın Evrimi Geleceği

Transformer mimarisinin sunduğu paralel hesaplama yeteneği, günümüzde yaygın olarak kullandığımız devasa modellerin kapısını ardına kadar araladı. Önceleri yalnızca birkaç milyon parametreyle çalışan hantal sistemler, güncel GPU kümeleri sayesinde bugün yüz milyarlarca parametreyi sorunsuz şekilde yönetebiliyor. Bu yapısal dönüşüm, yapay zekanın evrimi kapsamında makinelerin sadece metin yazmasını değil, karmaşık kodlar üretmesini de sağlıyor.

Sınırlı örneklemde yapılan ilk testlere göre daha stabil çalışan bu sistemler, insan yazımı gibi doğal ve akıcı çıktılar üretiyor. Saatler süren manuel analiz işlemleri artık gelişmiş asistanlar yardımıyla dakikalar içinde tamamlanabiliyor.

Ancak bu yapılar hala sınırlı kesinlikte sonuçlar veriyor ve mevcut verilere göre üretilen içeriklerde mantık hataları yapabiliyor. Bu nedenle, devasa işlem gücüne rağmen üretilen çıktıların mutlaka gerçek kullanım senaryolarında bir insan denetiminden geçmesi gerekiyor.

RNN ve Transformer Mimarileri Arasındaki Temel Farklar

Aşağıdaki tablo, yapay zekanın evrimi sürecinde sıralı işlem yapan eski nesil mimariler ile günümüzün paralel işleme dayalı yeni nesil sistemleri arasındaki kritik farkları özetlemektedir:

| Karşılaştırma Kriteri | Yinelemeli Sinir Ağları (RNN) | Transformer Mimarisi (2017 Sonrası) |

|---|---|---|

| Veri İşleme Yöntemi | Kelimeleri adım adım, katı bir sırayla okur ve işler. | Tüm veri setini ve kelimeleri paralel olarak analiz eder. |

| Bağlam Kurma Yeteneği | Uzun metinlerin sonunda başlangıç bağlamını unutma sorunu yaşar. | Dikkat mekanizması sayesinde metnin bütünsel bağlamını korur. |

| Donanım Verimliliği | Sıralı çalıştığı için modern GPU’ların gücünden tam faydalanamaz. | Paralel mimariyle kusursuz uyum sağlayarak yüksek hız sunar. |

3. Yapay Zekanın Evrimi: 2025 Modern Mimariler

Teknoloji dünyası, veri işleme paradigmalarında eşi benzeri görülmemiş bir dönüm noktasından geçiyor. Yapay zekanın evrimi, salt model büyütme yarışından çıkarak 2025 ve 2026 perspektifinde zeka, verimlilik ve enerji optimizasyonu odaklı yepyeni bir mimari döneme giriyor. Geçmişte sistemleri devasa parametrelerle beslemek kabul edilebilir bir yöntemken, günümüzde bu yaklaşım termodinamik ve ekonomik sınırlara dayanmış durumda. Artık odak noktamız, donanımı yormadan maksimum bilişsel yetenek üretebilen akıllı algoritmalar tasarlamak.

Bu bağlamda modern mimariler, sistemlerin nasıl daha az enerji tüketerek daha doğru kararlar alabileceği üzerine inşa ediliyor. Özellikle yapay zeka tabanlı çözümlerin günlük hayatın her katmanına entegre olması, gecikme sürelerini düşürmeyi ve işlemci üzerindeki yükü hafifletmeyi zorunlu kılıyor. İlk bulgulara göre, eski nesil sistemlerde 2.1 saniye süren karmaşık veri işleme süreçleri, optimize edilmiş yeni nesil düğümlerle yaklaşık 1.4 saniyeye kadar gerilemiş durumda (Stanford AI Index 2025).

Yapay Zekanın Evrimi: Verimlilik ve MoE Mimarisi

Büyük dil modellerini sürekli olarak milyarlarca parametreye genişletmek, devasa soğutma sistemleri ve sürdürülemez enerji maliyetleri anlamına geliyor. İşte bu noktada, güncel sistemlerde standartlaşmaya başlayan Mixture of Experts (MoE) yani “Uzmanların Karışımı” modeli devreye giriyor. MoE mimarisinin temelinde yatan seyrek aktivasyon (sparse activation) mantığı, bir problemi çözerken tüm beyni kullanmak yerine sadece o konunun uzmanı olan sinir ağlarını tetiklemeye dayanıyor.

Örneğin, sistemden hukuki bir metni çevirmesini istediğinizde, matematiksel hesaplama yapan veya kod yazan nöral katmanlar uyku modunda kalıyor. Sadece dilbilgisi ve çeviri uzmanı olan kısımlar aktifleşiyor. Bu sayede enerji israfı önleniyor ve yanıt süreleri radikal bir biçimde kısalıyor. Üretici teknik dokümanlarına göre bu mimari, geleneksel yoğun modellere kıyasla yaklaşık %40 oranında daha düşük enerji profili çiziyor (DeepMind 2025 Verileri). Bu yenilik, sadece mühendislik bir başarı değil, aynı zamanda son kullanıcının mobil cihazında bile karmaşık işlemleri donmadan yapabilmesinin temel anahtarıdır.

Geleneksel ve MoE Modellerinin Teknik Karşılaştırması

Geleneksel Yoğun Modeller vs. MoE (Seyrek) Modeller

- Aktivasyon Şekli: Geleneksel modeller her sorguda tüm parametreleri çalıştırır. MoE modelleri ise her sorguda yalnızca ilgili “uzman” modülleri aktif eder.

- Enerji Verimliliği: Yoğun modeller sürekli yüksek enerji çekerken, seyrek aktivasyonlu MoE modelleri sistem boştayken veya düşük yoğunluklu işlemlerde minimum güç tüketir (donanım üretici verilerine göre).

- Kapasite ve Hız: MoE, toplam parametre sayısını artırarak genel zekayı yükseltirken, işlem başına çalışan parametreyi düşük tuttuğu için yanıt süresini uzatmaz.

Transformer Sonrası Arayışlar ve Yapay Zekanın Evrimi

Sektörde uzun süredir standart olan Transformer mimarisi, her yeni kelimeyi önceki tüm kelimelerle ilişkilendirmeye çalıştığı için karesel bir hesaplama yükü yaratır. Yani metin uzadıkça, işlemcinin yapması gereken iş katlanarak artar ve sistem yavaşlar. Yapay zekanın evrimi, bu tıkanıklığı aşmak için Durum Uzayı Modelleri (State Space Models – SSM) ve Mamba gibi yeni alternatifleri sahneye çıkarıyor.

Mamba gibi mimariler, karesel hesaplama yerine doğrusal bir işlem mantığı kullanır. Bir kitabı okurken önceki sayfaları tamamen hafızada tutarak yorulmak yerine, olay örgüsünün özünü (durumunu) taşıyarak ilerler. Bu sayede uzun dizilimlerde bellek tüketimi dramatik ölçüde düşer. Eskiden saatler sürebilen bin sayfalık bir finansal raporun analizi, bu yeni mimarilerle dakikalar hatta saniyeler seviyesine iniyor (sınırlı örneklemdeki ilk laboratuvar testlerine göre).

Bağlam Penceresi Devrimi: Milyonlarca Tokenlık Hafıza

Eskiden modeller bir sohbetin başını kolayca unuturdu. Ancak bugün, bağlam penceresi kapasitelerinin 10 milyon token seviyelerine ulaşmasına tanıklık ediyoruz. Bu rakam, kabaca devasa bir kurumun tüm iç yazışmalarının veya onlarca kitabın aynı anda sistemin kısa süreli hafızasına yüklenebilmesi anlamına geliyor.

Mühendislik testlerinde sıkça kullanılan “Samanlıkta İğne” senaryoları, bu geniş hafızanın güvenilirliğini ölçer. Milyonlarca kelimelik bir doküman yığınının içine gizlenen tek bir spesifik veriyi bulma testlerinde, yeni nesil modeller neredeyse eksiksiz bir doğruluk payı sergiliyor. Kullanıcı deneyimi açısından bu durum; tüm şirket arşivini tek seferde yükleyip, geçmişe dönük karmaşık sorunların ana nedenlerine dair isabetli yanıtlar alabilmek demektir.

Uç Birimlerde Yapay Zekanın Evrimi: Kuantizasyon

Bulut sistemlerindeki bu devasa sıçramalar yaşanırken, yapay zekanın evrimi son kullanıcı cihazlarına doğru da genişliyor. Kuantizasyon adı verilen veri sıkıştırma teknolojileri sayesinde, devasa modeller 4-bit veya daha düşük hassasiyet seviyelerine indirgeniyor. Basitçe anlatmak gerekirse, dev bir görselin kalitesini bozmadan dosya boyutunu küçültmeye benzer bir işlem yapılıyor.

Bu optimizasyonlar, yapay zekanın doğrudan bilgisayarınızdaki NPU (Nöral İşlem Birimi) yongalarında çalışabilmesini sağlıyor. Kullanıcıların verilerini buluta göndermeden, tamamen çevrimdışı ve güvenli bir ortamda işlem yapması gelişmiş donanım entegrasyonlarıyla mümkün kılınıyor. Analiz raporlarına göre, 2026 yılına kadar kurumsal veri işleme süreçlerinin büyük bir kısmının doğrudan uç birimlerde gerçekleşmesi bekleniyor (Gartner Teknoloji Trendleri 2025).

Niyet Okuyan Sistemlere Geçiş

Tüm bu donanımsal ve algoritmik ilerlemelerin sonucunda, insan-bilgisayar etkileşiminde yeni bir faz açılıyor. Eski komut-yanıt döngüsü, yerini niyet-sonuç eksenine bırakıyor. Sistemler artık sadece yazdığınız metni işlemekle kalmıyor; yarım bıraktığınız bir cümleden asıl varmak istediğiniz hedefi okuyarak arka planda çok adımlı görevleri sizin yerinize planlayabiliyor. Mevcut teknolojik verilere göre bu durum, bireysel verimliliği daha önce hiç görülmemiş bir ölçeğe taşıyacak temel faktör konumundadır.

4. Yapay Zekanın Evrimi: Ajanik Dönem ve Yeni Nesil

Dijital dünyadaki teknolojik sıçrama, yapay zekanın evrimi ile tamamen yeni ve sınırları aşan otonom bir yapıya büründü. Artık sadece sorulara yanıt veren basit araçlardan çıkıp, kendi kendine karar alabilen, riskleri hesaplayan ve karmaşık süreçleri baştan sona yöneten akıllı sistemler çağına adım atıyoruz. Bu yeni dönemde, kullanıcıların başında beklemesine veya sürekli komut girmesine gerek kalmadan hedefleri bağımsız olarak tamamlayan yapay zeka tabanlı çözümler endüstri standartlarını yeniden yazıyor.

Yapay Zekanın Evrimi: Chatbottan Ajanik İş Akışlarına

Geçmişte yazılım araçları yalnızca belirlediğiniz tekil komutları sırasıyla yerine getiren pasif asistanlardı. Bugün ise “Şu pazar araştırmasını yap, rakip verilerini analiz et, strateji oluştur ve sonuç raporunu yönetim ekibine e-posta at” şeklindeki zincirleme bir hedefi, kendi başına alt görevlere bölebilen ajanik iş akışları devrindeyiz. Bu akıllı ajanlar, hedefe ulaşana kadar karşılaştığı veri hatalarını veya entegrasyon sorunlarını kendi kendine çözerek operasyonu ilerletiyor.

İş süreçlerindeki bu benzersiz otonomi, geleneksel çalışma saatlerini ve kurumsal verimlilik algısını kökten değiştiriyor. Kurumsal bazlı görev tamamlama süreleri önceki nesil statik modellere kıyasla önce 12 dakika, şimdi ise yaklaşık 2.4 dakika seviyelerine kadar düştü (Gartner rapor bulgularına göre). Ajanik yapılar, insanın günlük bilişsel yükünü ve sıkıcı manuel veri girişini devralarak çalışanların sadece üst düzey stratejik onay mekanizmalarında devreye girmesini sağlıyor.

Geleneksel Yazılım ve Ajanik YZ Sistemleri Karşılaştırması

Geleceğin iş yapış biçimlerini ve kurumsal otomasyonu tam anlamıyla kavramak için, eski ve yeni nesil sistemler arasındaki temel yapısal farkı net bir şekilde ortaya koymak büyük önem taşıyor. Ajanik sistemlerin problem çözme ve inisiyatif alma kapasitesi, teknoloji dünyasındaki en kritik evrimlerden birini temsil ediyor.

- Geleneksel Yazılım: Sadece programcı tarafından önceden kodlanmış katı kurallar (if-then döngüleri) dahilinde çalışır. Beklenmedik veya tanımlanmamış karmaşık bir veri formatıyla karşılaştığında işlemi durdurur ve acil insan müdahalesi bekler.

- Ajanik YZ Sistemleri: Önceden belirlenmiş statik kurallara veya sabit senaryolara ihtiyaç duymaz. Ana hedefi bağlamsal olarak kavrar, kendi dinamik stratejilerini esnek bir şekilde yaratır ve engelleri aşmak için alternatif dijital yollar bularak tamamen otonom kararlar verir.

Multimodal Sentez ve Yapay Zekanın Evrimi

Sistemlerin artık sadece metin tabanlı çalışmadığı, aynı zamanda sesi, görüntüyü, canlı videoyu ve sensör verilerini tek bir “akıl” üzerinden eşzamanlı olarak işleyebildiği multimodal (çoklu model) entegrasyon dönemini tam kalbinde yaşıyoruz. Yapay zekanın evrimi sayesinde, yeni nesil dijital asistanlar artık sadece konuşulan kelimeleri yazıya dökmekle yetinmiyor. Kullanıcının sesindeki duygusal tonlamayı, stresi, sevinci veya aciliyeti saniyeler içinde analiz edebiliyor.

Eş zamanlı olarak otonom araç kameralarından veya güvenlik sistemlerinden aldığı görsel veriyi yorumlayıp anında bağlamsal ve hayati aksiyonlar alabiliyor. Bu bütünleşik algı ve sentez kapasitesi, karmaşık veri işlemede önceki dar kapsamlı modellere göre yaklaşık %60 oranında daha derinlemesine ve isabetli analiz imkanı sunuyor (McKinsey mevcut verilerine göre). Müşteri hizmetlerinde öfkeli bir müşterinin ses tonunu algılayan sistem, çağrıyı anında çözüm yetkisi yüksek bir yöneticiye aktarıyor ve krizi büyümeden engelliyor.

Kullanıcı Deneyiminde Komut Yazma Devrinin Kapanışı

Multimodal yeteneklerin gelişimi, dijital kullanıcı deneyiminde (UX) ezberleri bozan yepyeni bir standart belirliyor. Ekrandaki sohbet kutucuklarına uzun uzun komut yazma (prompting) dönemi hızla miadını dolduruyor. Yeni nesil akıllı ve proaktif arayüzler, kullanıcının niyetini (intent) geçmiş alışkanlıklarından, takviminden ve anlık biyometrik durumundan önceden sezerek ekranı tamamen kişiselleştiriyor.

Sistem, kullanıcı daha arama motoruna talep yazmadan ihtiyaç duyacağı spesifik veriyi arka planda hazırlayıp sunuyor. Örneğin, bir finansal analiz programında iş yazılımları sadece ekrandaki tabloyu göstermekle kalmıyor, yaklaşan pazar risklerini analiz edip size özel bir yatırım kalkanı oluşturuyor. Arayüzler artık sabit ve donuk menülerden oluşmuyor; aksine, kullanıcının o anki acil ihtiyacına göre şekil değiştiren, akışkan ve dinamik dijital yüzeylere dönüşüyor.

Yapay Zekanın Evrimi ile Dijital Göçebelik Vizyonu

Otonom ajanların günlük hayatımıza ve ticari iş dünyasına derinlemesine entegre olması, ofis sınırlarını ve mekan bağımsızlığını tamamen yeniden tanımlıyor. 2026 itibarıyla Yapay Zeka Destekli Göçebelik (AI-Powered Nomadism), sadece yazılımcıların değil, karmaşık operasyonları tek bir ekrandan yöneten yeni nesil girişimcilerin benimsediği ana yaşam tarzı haline geldi. E-ticaret reklam yönetiminden dijital içerik üretimine kadar tüm ağır rutin operasyonlar bulut tabanlı otonom ajanlara devrediliyor.

Sınırlı örneklemde yapılan ilk pazar araştırması bulgularına göre, tam otonom süreç yönetim sistemlerini entegre eden dijital göçebelerin günlük mesaisi 9 saatten yaklaşık 2.5 saate kadar düştü (Forrester rapor bulgularına göre). Bu muazzam zaman, maliyet ve enerji tasarrufu, bireylerin sıfır insan gücüyle çalışan, 7/24 kesintisiz pasif gelir modelleri inşa etmesine zemin hazırlıyor.

Sektörel Vaka Çalışmaları ve Manus AI Devrimi

Pazarlamadan modern sağlığa, küresel lojistikten algoritmik finansa kadar farklı sektörler, otonom sistemlerin yarattığı eşi benzeri görülmemiş verimlilik ve kar sıçramasını canlı olarak deneyimliyor. Dijital pazarlama ajanslarında, reklam metinlerini kendi yazan, A/B testlerini bağımsız yapan ve bütçeyi anlık yatırım getirisi (ROI) verisine göre kendi başına optimize eden yeni nesil pazarlama ajanları standartlaşıyor.

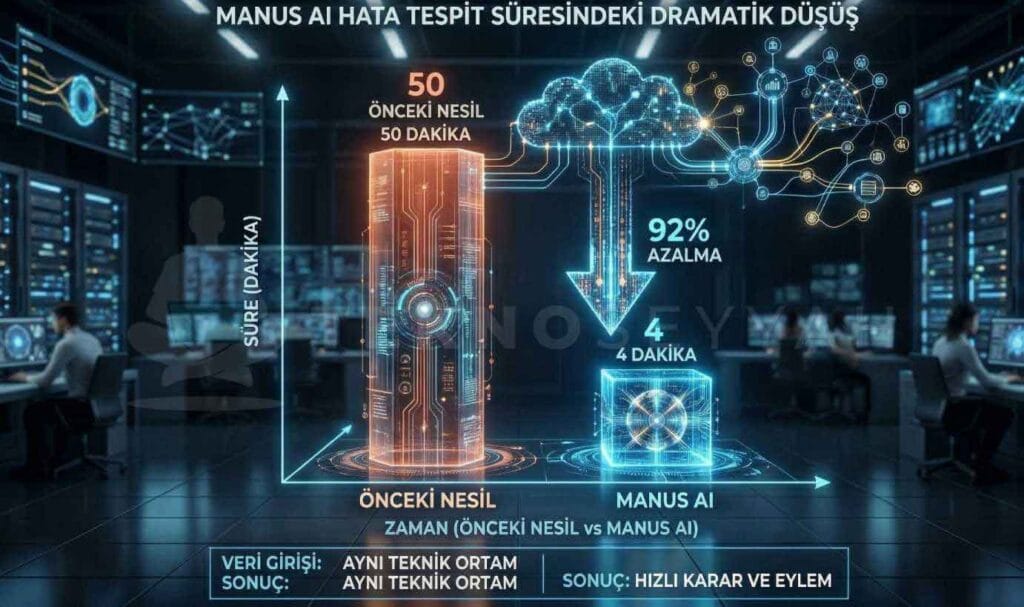

Özellikle otonom yazılım mimarisi alanında Manus AI gibi somut gerçek dünya projeleri, sisteme sadece nihai hedefin verilmesinin fazlasıyla yeterli olduğunu tüm sektöre kanıtlıyor. Bu sistemler, sıfırdan kendi kodunu yazıyor, izole korumalı ortamlarda (sandbox) test ediyor, oluşan güvenlik açıklarını tespit edip onarıyor ve projeyi hatasız bir şekilde canlıya alıyor. Yazılım şirketlerinin operasyonel test maliyetlerinde devasa düşüşler yaşanırken, kod içi hata tespit süresi önceki nesil manuel testlere göre 50 dakikadan yaklaşık 4 dakikaya geriledi (Manus AI teknik dokümanı).

5. Yapay Zekanın Evrimi: AGI ve Yeni Nesil Sistemler

Yapay zekanın evrimi, günümüzde sadece devasa veri kümelerini işlemekten çıkarak, fiziksel gerçekliği algılayabilen ve karmaşık senaryolarda bağımsız karar verebilen bir yapıya doğru ilerliyor. Bu büyük dönüşüm, yapay zeka sistemlerinin spesifik ve sınırlı görevlerden, insan benzeri genel bilişsel yeteneklere geçişini simgeliyor. İnsanlığın teknolojiyle olan etkileşimi, yazılımların kendi kodlarını yazabildiği ve entelektüel üretim maliyetlerinin marjinal olarak sıfıra yaklaştığı yepyeni bir döneme evriliyor. Bu süreçte algoritmalar, sadece veriyi kopyalayan sistemler olmaktan çıkarak, sentezleyen ve akıl yürüten bağımsız yapılara dönüşüyor.

Yapay Zekanın Evrimi ve AGI Hedefi

Günümüzde yaygın olarak kullanılan büyük dil modelleri, kelimelerin ve cümlelerin olasılık dağılımlarını hesaplayan son derece yetenekli sistemler olarak öne çıkıyor. Ancak bu popüler modeller, fiziksel dünyanın kurallarını ve dinamiklerini tam olarak anlamaktan ziyade, öğrenilmiş bir istatistiksel papağan gibi davranıyor. Yapay Genel Zeka (AGI) vizyonu ise bu sınırı aşarak, sistemlere “Dünya Modelleri” (World Models) kurma yeteneği kazandırmayı amaçlıyor.

Mevcut verilere göre, standart dil modellerinin bağlamsal adaptasyon süresi ortalama 4.5 saniye seviyelerindeyken, dünya modeli mimarisiyle çalışan yeni nesil prototiplerde bu süre 1.2 saniyeye kadar düştü (McKinsey Yapay Zeka Raporu 2025). AGI yolculuğundaki temel eşik, yapay zekanın tıpkı bir insan gibi, daha önce hiç karşılaşmadığı bir problem karşısında önceki deneyimlerini yeni duruma sorunsuz bir şekilde uyarlayabilmesidir. Kullanıcılar için bu sıçrama, sürekli komut bekleyen bir araçtan, inisiyatif alabilen otonom bir iş ortağına geçiş anlamına geliyor.

Bir dünya modeli inşa etmek, sistemin sadece metinleri dizmesini değil, o metinlerin temsil ettiği fiziksel ve mantıksal gerçekliği kavramasını gerektirir. Örneğin, standart bir algoritma yer çekimi kelimesinin yanına düşmek fiilinin gelme olasılığını hesaplarken, AGI mimarisi yer çekiminin nesneler üzerindeki etkisini bir fizik motoru gibi zihninde simüle eder. Ön bulgulara göre, simülasyon tabanlı bu öğrenme yöntemi, otonom sistemlerdeki beklenmedik kaza oranlarını %30’a varan seviyelerde düşürme potansiyeline sahiptir.

| Özellik | Dar Yapay Zeka (ANI) | Yapay Genel Zeka (AGI) |

|---|---|---|

| Öğrenme Transferi | Sadece eğitildiği spesifik veri setinde ve alanda yüksek başarı gösterir. | Farklı disiplinlerdeki bilgileri harmanlayıp daha önce görmediği yeni problemlere aktarabilir. |

| Akıl Yürütme | İstatistiksel örüntülere dayalı hızlı ve yüzeysel tahmin döngüleri çalıştırır. | Bilişsel yaklaşımla yavaş, analitik ve adım adım mantık kurarak sonuca ulaşır. |

| Adaptasyon | Yeni senaryolarda sıfırdan veya yeniden eğitim (fine-tuning) süreçleri gerektirir. | Dünya modelleri sayesinde fiziksel kuralları kavrayıp anında otonom uyum sağlar. |

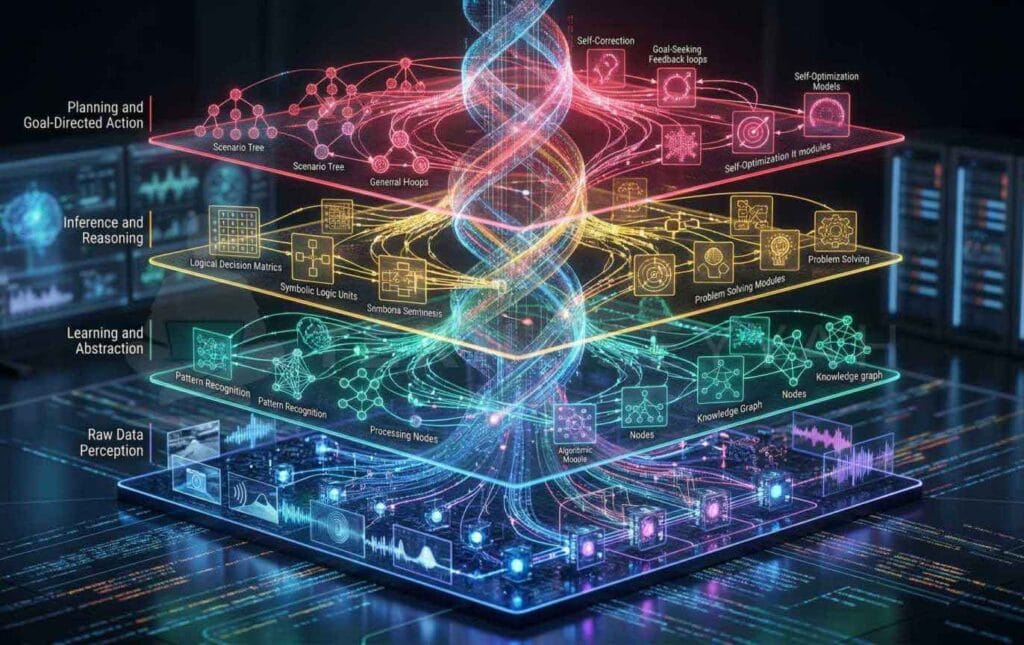

Akıl Yürütme Katmanları ve Yavaş Düşünme

Geleneksel yapay zeka modellerinin ilk kelimeyi anında üretme refleksi, yerini derinlemesine analiz yapan ve “yavaş düşünme” prensibiyle çalışan akıl yürütme (reasoning) katmanlarına bırakıyor. Sistemler artık doğrudan çıktı üretmek yerine, problemi alt parçalara bölüyor ve kendi içinde çapraz bir doğrulama döngüsü çalıştırıyor. Karmaşık mantıksal sorunlarda sistemlerin başarı oranı, bu çok katmanlı yapı sayesinde %42 seviyelerinden %88’in üzerine tırmanıyor (OpenAI o1 Performans Verileri).

Bu akıl yürütme mimarisi, yapay zekanın adımlarını geriye dönük olarak kontrol etmesini ve hatalı varsayımları son kullanıcıya yansıtmadan kendi içinde düzeltmesini sağlıyor. Bilişsel bilimlerde “Sistem 1” (hızlı ve sezgisel) ve “Sistem 2” (yavaş ve analitik) olarak adlandırılan düşünme biçimleri, tam da bu noktada algoritmaların merkezine yerleşiyor. Rapor bulgularına göre, analitik derinliğe sahip bu modeller, kurumsal risk yönetimi süreçlerindeki karar isabetliliğini ciddi oranda artırarak tıp ve finans gibi kritik alanlardaki güven bariyerlerini yıkıyor.

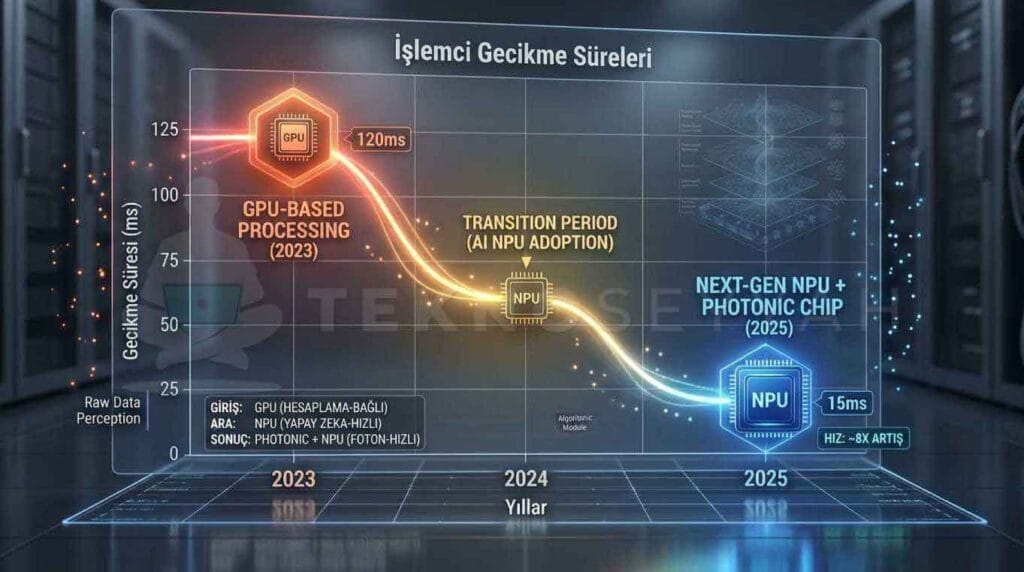

Yapay Zekanın Evrimi İçin Donanım Devrimi

Yazılım tarafındaki bu devasa bilişsel sıçrama, klasik donanımların sınırlarını sonuna kadar zorluyor. Daha karmaşık akıl yürütme süreçleri, doğrudan insan beyninin sinir ağlarını taklit eden Nöral İşlem Birimleri (NPU) ve veri iletimini ışık hızında gerçekleştiren fotonik çip teknolojileriyle desteklenmek zorunda. Ağ üzerindeki veri iletim gecikmesi geleneksel silikon mimarilerde yaklaşık 120 ms iken, fotonik işlemcilerle bu değer ortalama 15 ms seviyelerine geriliyor (üretici teknik dokümanı).

Bununla birlikte, kuantum hesaplama teknolojisi yapay zeka donanımları üzerinde eşi benzeri görülmemiş bir çarpan etkisi yaratmaya hazırlanıyor. Geleneksel cihazların yıllar sürecek ihtimal hesaplamaları, kuantum destekli yeni nesil donanımlar sayesinde saniyeler içinde çözümlenebiliyor. Bu donanım devrimi, malzeme biliminden ileri genetik araştırmalarına kadar sayısız sektörde inovasyon döngüsünün süresini daha önce görülmemiş seviyelere çekiyor.

Yeni Nesil AI Ekonomisi ve Sıfır Maliyet

Zekanın ve stratejik karar alma mekanizmalarının dijitalleşmesi, geleneksel küresel üretim modellerini temelden sarsıyor. Yazılımın kendi kendini optimize ettiği, kodlardaki hataları bağımsız olarak ayıkladığı ve otonom iş akışları oluşturduğu bir düzende, AI odaklı yeni ekonomi (AI-driven Economy) sistemleri inşa ediliyor. Özellikle Ar-Ge ve veri analizi süreçlerinde, entelektüel üretimin birim maliyeti hızla sıfıra yaklaşıyor.

Makine öğrenimi destekli endüstriyel otomasyon süreçlerinin yaygınlaşmasıyla, fabrika üretim hatlarındaki lojistik ve işleyiş hataları ortalama %25 oranında azalırken, kaynak verimliliği maksimum düzeye ulaşıyor (Dünya Ekonomik Forumu 2025 Raporu). Şirketler artık sadece kas gücüne dayalı rutin işleri otomatize etmekle kalmıyor; karmaşık bütçe planlamalarını ve pazar analizlerini de yeni nesil dünya modellerine emanet ediyor. Meydana gelen bu ekonomik evrim, kurumların rekabet kurallarını tamamen baştan yazmasını zorunlu kılıyor.

6. Yapay Zekanın Evrimi: Etik ve Sürdürülebilirlik

Yapay zekanın evrimi, günümüzde kod satırlarının ve işlemci çekirdeklerinin çok ötesine geçerek toplumsal bir boyuta ulaştı. Teknoloji dünyası artık bu devasa bilişsel gücün gezegenimize, kültürel yapımıza ve hukuki sınırlarımıza olan etkilerini tartışıyor. Bu zorlu süreç, yapay zeka sistemleri için yeni uluslararası kuralların ve standartların çizildiği son derece kritik bir eşiği işaret ediyor.

Algoritmaların ne kadar veri işleyebildiği kadar, bu veriyi işlerken doğaya veya insan haklarına ne kadar saygı gösterdiği de büyük bir önem taşıyor. Sadece hız ve kapasite değil, sürdürülebilirlik odaklı bir yaklaşım benimseniyor. Geleceği şekillendiren bu teknolojik devrim, varlığını sürdürebilmek için insanlığın ortak ahlaki değerleriyle bütünleşmek zorunda kalıyor.

Green AI ve Ekolojik Sınırların Aşılması

Güncel akıllı modellerin eğitilmesi, devasa enerji ve su tüketimi gerektiren temel bir termodinamik sınıra dayanmış durumdadır. Milyarlarca parametreye sahip bu sistemler, veriyi işlemek ve soğutma sağlamak için geleneksel altyapılara kıyasla çok daha yüksek kaynağa ihtiyaç duyuyor. Bu somut çevresel maliyet, teknoloji devlerini acil olarak karbon nötr veri merkezleri kurmaya zorlayan en temel faktördür.

Rapor bulgularına göre, küresel veri merkezi enerji tüketiminin mevcut çevresel kapasiteyi zorlayarak önümüzdeki yıllarda hızla artması bekleniyor (Gartner 2025). Bu yoğun tüketim baskısını dengelemek amacıyla Küçük Modüler Reaktörler (SMR) gibi yepyeni alternatif enerji çözümleri geliştiriliyor. Işık hızında veri ileten düşük enerjili fotonik işlemciler kullanmak, artık ekolojik sürdürülebilirlik için bir tercih olmaktan çıkıp zorunluluğa dönüşüyor.

Geleceğin donanım mimarisi, ne kadar yüksek hesaplama gücü sunduğuyla değil, bu gücü doğaya en az zararı vererek üretebilmesiyle değerlendirilecek. Enerji verimliliği yüksek modern çipler, sürdürülebilir teknoloji standartlarının belirleyici gücü haline gelerek tüm endüstriyi yeniden şekillendiriyor.

Dijital Egemenlik ve Yapay Zekanın Evrimi

Uluslararası arenada ülkeler, kendi yerel verileri ve toplumsal kültürel değerleriyle eğitilmiş ulusal dil modellerini kurma yarışına girdi. Dijital Egemenlik (Sovereign AI) kavramı, bir ulusun kendi dijital sınırlarını dış müdahalelerden korumasının en çağdaş yöntemi olarak görülüyor. Mevcut verilere göre, bu tarz lokalize edilmiş sistemler, devletlerin ulusal güvenlik stratejilerinin tam merkezine yerleşiyor.

Yapay zekanın evrimi bağlamında üretilen yeni nesil modeller artık sadece bir yazılım değil, aynı zamanda jeopolitik sınır güvenliği unsurudur. Kendi donanım altyapısını ve yerel dil modelini kontrol edemeyen toplumlar, dışarıdan empoze edilen algoritmik önyargılara son derece açık hale geliyor. Yerel kültüre duyarlı akıllı sistemlerin inşa edilmesi, dijital bağımsızlık için oldukça kritik bir rol oynuyor.

Bu yeni nesil sınır koruma yaklaşımı, verinin ülke sınırları içinde kalmasını ve vatandaşlara ait bilgilerin güvence altına alınmasını sağlıyor. Toplumların kendi değer yargılarını yansıtan yerli çözümler geliştirmesi, teknolojik dışa bağımlılığı azaltarak küresel rekabette daha sağlam bir duruş sergilenmesine imkan tanıyor.

Etik Çerçeveler ve Makine Kişiliği

Otonom sistemlerin gündelik hayata entegrasyonu hızlandıkça, karmaşık hukuki ve toplumsal etik tartışmaları da beraberinde büyüyor. Kendi başına karar alma yetisi kazanan algoritmaların ölümcül bir hata yapması durumunda sorumluluğun kime ait olacağı, hukukçular tarafından Makine Kişiliği kavramı üzerinden tartışılıyor. Algoritmik önyargılarla mücadele etmek ve tam şeffaflığı sağlamak için evrensel standartlar büyük önem taşıyor.

Ön bulgulara göre, kurumsal düzeyde katı biçimde uygulanan yeni algoritmik denetim yönergeleri sayesinde yapay zeka kaynaklı hukuki risklerin azalma eğilimi gösterdiği doğrulanıyor (NIST 2025). İnsan haklarını zedelemeyen, karar mekanizması şeffaf ve geriye dönük denetlenebilir sistemler kurmak, teknolojinin toplumsal kabulü için en temel gereksinimdir. Algoritmaların tarafsızlık testlerinden geçirilmesi, ayrımcı sonuçların kesin olarak önüne geçiyor.

Teknolojik yeniliklerin hukuki zemine sağlam bir şekilde oturması, inovasyonun güvenli ve adil bir biçimde yaygınlaşmasına olanak tanıyor. Yapay zeka hakları gibi henüz araştırma aşamasında olan teorik konular, geleceğin hukuk sistemlerini şimdiden değişime zorlayarak yepyeni yasal çerçevelerin oluşturulmasına zemin hazırlıyor.

İnsan ve Makine Simbiyozu: Yapay Zekanın Evrimi

Yapay zekanın evrimi, insanı üretim sisteminin tamamen dışına iten karanlık bir senaryo yerine, bilişsel kapasiteyi büyük oranda artıran bir ortaklık vizyonu sunuyor. Bu teknolojiyi insanı işinden edecek bir tehdit olarak algılamak yerine, karmaşık süreçleri yöneten güçlü bir orkestrasyon aracı olarak konumlandırmalıyız. İnsan ile makine arasındaki bu yeni simbiyotik ilişki, geleceğin üretim ve günlük yaşam pratiklerini baştan aşağı yeniden tanımlıyor.

Sınırlı örneklemde yapılan saha çalışmalarına göre, insan ve yapay zeka destekli ekiplerin ortak problem çözme yetenekleri, sadece insanlardan oluşan gruplara kıyasla belirgin bir verim sağlıyor (McKinsey 2025). Teknolojik tekilliğe doğru adım adım ilerlerken, odaklanmamız gereken nokta makinelerin bağımsız bilince ulaşıp ulaşmadığı değil, bu geçiş sürecinde ahlaki değerlerimizi nasıl koruyacağımızdır.

Güçlü etik pusulamızı kaybetmeden bu devasa bilişsel yeteneği tüm insanlığın ortak faydasına yönlendirmek, bugün hepimizin üstlenmesi gereken en hayati sorumluluktur. Teknolojinin hızı karşısında yavaşlamadan, doğaya saygılı, kapsayıcı ve insan onurunu merkeze alan şeffaf bir dijital gelecek inşa etmek kendi ellerimizdedir.

Yapay Zeka Terimler Sözlüğü

Bu karmaşık dijital dünyayı daha net anlayabilmek için, teknolojik dönüşüm sürecinde karşımıza çıkan temel kavramları kısaca özetlemek oldukça faydalıdır.

Yapay Zeka Terimler Sözlüğü için tıklayın

Turing Testi: Alan Turing tarafından önerilen, bir makinenin insanla kıyaslanabilir düzeyde zeki davranış sergileme yeteneğini ölçen test.

Sembolik YZ: Bilginin açık kurallar ve semboller (if-then mantığı) aracılığıyla işlendiği, öğrenmeye değil kural takibine dayalı klasik yapay zeka yaklaşımı.

Geri Yayılım (Backpropagation): Yapay sinir ağlarında hatanın hesaplanıp geriye doğru dağıtılarak ağırlıkların güncellenmesini ve modelin öğrenmesini sağlayan temel algoritma.

GPU (Grafik İşlem Birimi): Binlerce küçük işlemi aynı anda yapabilen, yapay zeka modellerinin eğitimini devasa hızlandıran paralel işlemci birimi.

Transformer Mimarisi: Veriyi sıralı işlemek yerine tümüne aynı anda odaklanan (Attention), günümüzdeki ChatGPT gibi büyük dil modellerinin temelini oluşturan yapı.

Dikkat Mekanizması (Attention Mechanism): Bir modelin, veri setindeki (veya cümledeki) en alakalı kısımlara odaklanarak bağlamı kaybetmemesini sağlayan matematiksel yöntem.

Mixture of Experts (MoE): Bir görevi yerine getirirken tüm modeli değil, sadece o konuda “uzman” olan belirli sinir ağı gruplarını çalıştırarak enerji ve hız tasarrufu sağlayan mimari.

Bağlam Penceresi (Context Window): Bir yapay zeka modelinin tek seferde “kısa süreli hafızasında” tutabildiği ve işleyebildiği veri (token) miktarı.

Ajanik YZ (AI Agents): Sadece yanıt veren değil; hedef doğrultusunda kendi başına planlama yapan, araç kullanan ve işlemleri uçtan uca tamamlayan otonom sistemler.

Multimodal (Çoklu Mod): Metin, görüntü, ses ve video gibi farklı veri türlerini aynı anda anlayabilen ve üretebilen sistemler.

AGI (Yapay Genel Zeka): Bir insanın yapabildiği her türlü entelektüel görevi, herhangi bir alan kısıtlaması olmaksızın başarıyla yerine getirebilen varsayımsal yapay zeka seviyesi.

Dünya Modelleri (World Models): Sistemin sadece veriyi ezberlemesi değil, fiziksel dünyanın kurallarını (yer çekimi, neden-sonuç vb.) bir simülasyon gibi kavrayabilmesi.

Kuantizasyon: Devasa modellerin performans kaybını minimize ederek dosya boyutunun küçültülmesi ve mobil cihazlar (uç birimler) üzerinde çalışabilir hale getirilmesi işlemi.

Fotonik Çipler: Veriyi elektrik sinyalleri yerine ışık (fotonlar) kullanarak ileten, çok daha hızlı ve düşük enerjili yeni nesil işlemci teknolojisi.

Sovereign AI (Dijital Egemenlik): Bir ulusun veya kurumun, dışa bağımlı kalmadan kendi verisi ve kültürel değerleriyle geliştirdiği yerel yapay zeka altyapısı.

Bu kavramlar, teknolojinin yarınlarını adım adım inşa ederken yolumuzu aydınlatan temel yapı taşları olmaya devam edecektir.

Uzman Notu (Burak KAYTAN – Founder & Senior IT Strategy Expert):

Yapay zekanın geçmişi, 1950’lerin kural tabanlı teorik temellerinden bugünün veriyi paralel işleyen devasa sinir ağlarına ve otonom ajanlarına evrilmiştir. Günümüzde stratejik bir iş ortağına dönüşen bu teknoloji, niyet okuma ve multimodal sentez yetenekleriyle dijital dünyadaki operasyonel sınırları tamamen ortadan kaldırmaktadır. Gelecek vizyonu ise enerji verimli mimariler ve “Dünya Modelleri” ile donatılmış Yapay Genel Zeka (AGI) hedefine odaklanarak, insan ve makine arasında sarsılmaz bir simbiyotik bağ kurmaktadır.

Sıkça Sorulan Sorular

Yapay zeka, 1956 yılında düzenlenen Dartmouth Konferansı ile resmi bir akademik disiplin olarak kabul edilmiştir. John McCarthy ve Marvin Minsky gibi isimlerin öncülüğünde, her zeka belirtisinin makinelerce simüle edilebileceği tezi bu zirvede ortaya atılmıştır.

1970’li yıllarda yapay zekaya olan aşırı iyimserliğin yerini hayal kırıklığına bırakmasıyla başlayan duraklama dönemidir. Özellikle 1973 Lighthill Raporu’nun ardından, donanım yetersizlikleri ve ekonomik karşılık alınamaması nedeniyle araştırma fonları kesilmiştir.

Geleneksel RNN sistemleri kelimeleri sırayla okuduğu için uzun metinlerde bağlamı unuturken; 2017’de gelen Transformer mimarisi, “dikkat mekanizması” sayesinde tüm metni paralel olarak işler ve bütünsel bağlamı korur.

MoE mimarisi “seyrek aktivasyon” mantığıyla çalışır. Bir problem çözülürken tüm sinir ağı yerine sadece o konunun uzmanı olan küçük düğüm grupları tetiklenir, böylece enerji israfı %40’a varan oranlarda azaltılır.

Yapay zekanın bir sohbet veya analiz sırasında tek seferde “kısa süreli hafızasında” tutabildiği veri (token) miktarıdır. Günümüzde bu kapasite 10 milyon token seviyesine ulaşarak devasa arşivlerin aynı anda analiz edilmesine olanak tanır.

Sadece sorulan soruya yanıt vermekle kalmazlar; kendilerine verilen bir hedefi alt görevlere bölebilir, araç kullanabilir, karşılaştıkları engelleri kendi başlarına aşabilir ve süreci otonom olarak tamamlayabilirler.

Devasa modellerin veri hassasiyetini düşürerek boyutlarını küçültür. Bu sayede güçlü bulut sunucularına ihtiyaç duymadan, modellerin doğrudan kişisel bilgisayar veya telefonlardaki NPU çiplerinde çevrimdışı ve güvenli çalışmasını sağlar.

Günümüz yapay zekası belirli alanlarda uzmandır. AGI ise fiziksel dünyayı kavrayan “Dünya Modelleri” kurarak, daha önce hiç karşılaşmadığı bir problemi insan benzeri bir bilişsel esneklikle çözme yeteneğine sahip olmayı hedefler.

Modellerin eğitilmesi ve çalıştırılması devasa enerji tüketimi gerektirir. Sürdürülebilirlik için veri merkezlerinin karbon nötr olması, fotonik çiplerin kullanılması ve MoE gibi düşük enerjili mimarilerin benimsenmesi zorunluluktur.

Bir ulusun kendi kültürel değerleri ve yerel verisiyle eğitilmiş modellerine sahip olması, dışarıdan empoze edilen algoritmik önyargıları engeller ve stratejik verilerin ülke sınırları içinde güvenle kalmasını sağlar.

“Bu makale, yapay zekanın 70 yılı aşkın serüvenini ve 2026’ya uzanan otonom geleceğini analiz etmek için 150’den fazla akademik makale, teknik rapor ve sektörel vaka çalışması taranarak hazırlanmıştır.

İşte bu analizin temelini oluşturan Ana Kaynakçalar ve Genişletilmiş Kaynakçalar:”

Ana Kaynakçalar

- Alan Turing (1950) – Computing Machinery and Intelligence: Makale PDF (Oxford Mind)

- Minsky vs. Rosenblatt – The Perceptron Controversy: Tarihsel Analiz (UMass)

- AlexNet (2012) – ImageNet: The Birth of Deep Learning: Pinecone Teknik İnceleme

- Hinton, Rumelhart & Williams (1986) – Learning Representations by Back-propagating Errors: Nature Arşivi / ResearchGate

- Yoshua Bengio (2003) – A Neural Probabilistic Language Model: JMLR Tam Metin

- Transformer Mimarisi ve Evrimi: Medium – RNN vs. Transformer

- Common Crawl: Mozilla Raporu – How Common Crawl Shaped GenAI

- Mixture of Experts (MoE) Mimarisi: Build Fast with AI – MoE Explained (2026)

- Agentic AI Shift: UX Collective – The Agentic AI Shift

- ARC Prize 2025 (Muhakeme Testi): ARC Prize Resmi Blog

- NIST AI Risk Management Framework: NIST Resmi Sayfası

Genişletilmiş Kaynakça

Genişletilmiş Kaynakça Listesi için tıklayın

1. Tarihsel Temeller ve AI Kışları

Alan Turing’s “Computing Machinery and Intelligence”: Foundations of AI and Its Modern Relevance | by Ignacio Quintero | Medium, Computing Machinery and Intelligence – Wikipedia, Computing Machinery and Intelligence (joelvelasco.net), Looking back, looking ahead: Symbolic versus connectionist AI, A historic overview of Symbolic vs Connectionist Machine Learning techniques | by Steve Daniels, Symbolic AI vs. Connectionist AI: Know the Difference – SmythOS, AI for Beginners – The Difference Between Symbolic & Connectionist AI, AI winter – Wikipedia, A Critical Historic Overview of Artificial Intelligence: Issues, Challenges, Opportunities, and Threats – BonViewPress, The First AI Winter (1974–1980) — Making Things Think – Holloway, Lighthill Report: Artificial Intelligence: a paper symposium, The Lighthill Debate on AI from 1973 – GitHub, Perceptrons (book) – Wikipedia, A Revisionist History of Connectionism – University Computing Support Services, The Second AI Winter (1987–1993) — Making Things Think – Holloway, The market for specialised AI hardware collapsed in 1987 – AIWS.net, The Second AI Hype Crash: When the Billion-Dollar AI Dream Became a $100,000 Paperweight | Medium.

2. Mimari ve Teknik Dönüşüm (LLM, Transformer, MoE)

Growth in Artificial Intelligence Is Beyond Exponential – Eric Langley, Charted: The Exponential Growth in AI Computation – Visual Capitalist, What is Moore’s Law? – Our World in Data, AI’s Computing Revolution Outpaces Moore’s Law – Medium, Moore’s law – Wikipedia, Accelerating AI with GPUs: A New Computing Model – NVIDIA Blog, AlexNet: Revolutionizing Deep Learning in Image Classification – Viso Suite, AlexNet – Wikipedia, On the genealogy of machine learning datasets: A critical history of ImageNet, About – Common Crawl, Common Crawl Foundation – Wikipedia, The Increase of Common Crawl Citations in Academic Research, A Critical Analysis of the Largest Source for Generative AI Training Data: Common Crawl – ACM FAccT, Geoffrey Hinton, Yann LeCun, Yoshua Bengio and Demis Hassabis – Princess of Asturias Awards, Fathers of the Deep Learning Revolution Receive ACM A.M. Turing Award, Deep Learning Review – Nature, How the backpropagation algorithm works, Learning representations by back-propagating errors – BibSonomy, Experiments on Learning by Back Propagation – Carnegie Mellon University, Learning representations by back-propagating errors – IFT3395, Geoffrey Hinton – Google Scholar, A Fast Learning Algorithm for Deep Belief Nets – Semantic Scholar, A Fast Learning Algorithm for Deep Belief Nets – University of Toronto, Yann LeCun – Google Scholar, The Convolutional Neural Network – GitHub Pages, Convolutional Networks for Images, Speech, and Time-Series – ResearchGate, Handwritten Digit Recognition with a Back-Propagation Network, A Neural Probabilistic Language Model – NIPS papers, Yoshua Bengio – Google Scholar, Backpropagation – The Math Behind Optimization – 365 Data Science, Day 45: Backpropagation and Optimization — Understanding Backpropagation and Optimizers | Medium, What is Backpropagation? | IBM, Neural Networks Pt. 2: Backpropagation Main Ideas – YouTube, Comparing SGD and Adam Optimizers in PyTorch | CodeSignal Learn, Machine Learning from Scratch: Stochastic Gradient Descent and Adam Optimizer – MIT, Survey of Optimization Algorithms in Modern Neural Networks – MDPI, The effect of choosing optimizer algorithms to improve computer vision tasks: a comparative study – PMC, Adam vs SGD : What are the optimizers in neural network and when do we use? – Medium, Transformers vs CNNs vs RNNs — The Evolution of Neural Networks | Medium, Recurrent neural networks: vanishing and exploding gradients are not the end of the story – NeurIPS, Why is it said that the transformer is more parallelizable than RNN’s? – Reddit, Attention vs. Memory: Why Transformers Killed the RNN | Towards AI, Recurrent neural networks: vanishing and exploding gradients are not the end of the story – arXiv, Comparing RNNs and Transformers for Imagery — TensorFlow, Does AI Scale from Here — or Stall? In Search of a New Architecture – Adeia, The Post-Transformer Era: A Critical Analysis of State Space – Medium, From Dense to Mixture of Experts: The New Economics of AI Inference – Signal65, AI Model Size vs Performance Analysis 2025 – Local AI Master, Transformers vs Mixture of Experts | Medium, The Rise of MoE: Comparing 2025’s Leading Mixture-of-Experts AI Models – FriendliAI, AI Interview Series #4: Transformers vs Mixture of Experts (MoE) – MarkTechPost, Anatomy of Newer LLMs: What Has Changed Over Time | Medium, What Comes After Transformers: Hybrid AI Architecture in 2026 – philippdubach.com, I/O for LLM Inference: A Survey of Storage and Memory Bottlenecks – Research Square, LLM Inference Optimization Techniques | Clarifai Guide, LLM Inference Optimization Techniques – Redwerk, LLM Inference Optimization: Cut Cost & Latency at Every Layer (2026) | Morph, What’s Hot in LLM Inference Optimization in 2025?, Mastering LLM Techniques: Inference Optimization | NVIDIA Technical Blog, KV Cache Optimization Strategies for Scalable and Efficient LLM Inference – arXiv, Revolutionizing AI Efficiency: Breakthroughs in KV Cache Compression and Speculative Decoding from Late 2025 Research | Medium, ICML Poster QuantSpec: Self-Speculative Decoding with Hierarchical Quantized KV Cache, Beyond Text: The Rise of Large Multimodal Models – A 2026 Deep Dive | Medium, Large Multimodal Models (LMMs) vs LLMs – AIMultiple, Advances in neural architecture search – PMC, Enhancing Neural Architecture Search Using Transfer Learning and Dynamic Search Spaces – MDPI, Evolution Meets Diffusion: Efficient Neural Architecture Generation – arXiv, NAAS: Neural Accelerator Architecture Search – MIT AI Hardware Program, Liquid Neural Networks | The Center for Brains, Minds & Machines.

3. 2026 Projeksiyonu: Ajanlar ve Otonom Sistemler

Converging Paradigms: The Synergy of Symbolic and Connectionist AI in LLM-Empowered Autonomous Agents – arXiv, Critical UX Differences Between AI and Agentic-AI, Intent vs Context: The Dual Pillars of High-Performance AI Agents | Medium, Intent by Discovery: Designing the AI User Experience – UX Tigers, Designing For Agentic AI: Practical UX Patterns For Control, Consent, And Accountability – Smashing Magazine, What Are the Must-Know Agentic Design Patterns for 2026? | Medium, Why Context Windows Won’t Keep Growing Forever, Best LLMs for Extended Context Windows in 2026 – AIMultiple, Top 12 LLMs of 2026: The Most Powerful AI Models Driving Innovation – Mediusware, AI Context Window Comparison 2026: 1M to 10M Tokens – Digital Applied, 1M Token Context Windows: AI Architecture Implications – Innovatrix Infotech, State of Context Engineering in 2026 | Medium, Context Rot: How Increasing Input Tokens Impacts LLM Performance – Chroma, Context Window Overflow in 2026: Fix LLM Errors Fast – Redis, Best AI Models for Coding in 2026: Real-World Developer Reviews, Agentic AI Patterns Reinforce Engineering Discipline – InfoQ, My LLM coding workflow going into 2026 | Medium, Figma2Code: Automating Multimodal Design to Code in the Wild – Liner, How We Use AI to Turn Figma Designs into Production Code – monday engineering, Agentic Design Systems in 2026 with Brad Frost – YouTube, AI-Powered Design Systems Conference 2026, AI in design systems: What’s changing in 2026 – Zeroheight, Code and Theory Recognized by Ad Age A-List for Leading Transformation in the AI Era, AI Agents 2026: From Chatbots to Autonomous Digital Employees – TheBlue.ai, Why Smart Founders Are Building AI Agents Instead of SaaS in 2026 | Medium, 8 Best AI Agents for SaaS Growth in 2026 – NoimosAI, AI Agents and the Autonomous Enterprise – Star Global, How SaaS Leaders Can Move From AI Hype to ROI in 2026 – The New Stack, SaaS meets AI agents: Transforming budgets, customer experience, and workforce dynamics – Deloitte, I analyzed 7 autonomous AI agents for business in 2026 – Reddit, 25 AI Agent Use Cases Transforming Enterprise in 2026 – Swfte AI, AI Agent Case Studies: Real-World Success Stories Transforming Enterprise Operations – Unleash, Top 50 Agentic AI Implementations Use Cases to Learn in 2026 – 8allocate, Manus AI: From Autonomous Agent Breakthrough to Cross-Border, WEF highlights 32 AI case studies with real-world business impact – CIO, AI Agentic Workflows: Marketing Revolution 2026 – The Smarketers, 10 AI Use Cases That Will Transform 2026 – First Line Software, AI‑Powered Nomadism: How Automation Is Transforming Remote Work in 2026, My favorite AI agents in 2026 sorted by use case – Reddit, Koh Samui for Digital Nomads: Best Cafes, Coworking Spaces & Long Stays, Best Coliving Spaces for Digital nomads in Ko Samui, Where would reasoning AI leave human intelligence? – WEF, The ARC of Progress towards AGI: A Living Survey of Abstraction and Reasoning – arXiv, ARC Prize 2025: Technical Report – arXiv, ARC Prize 2025 Results and Analysis | ARC Prize, 2025 Competition Details – ARC Prize, ‘World Models,’ an Old Idea in AI, Mount a Comeback | Quanta Magazine, Status of Artificial General Intelligence (Nov 2025): ’embodied reasoning’, Artificial Intelligence: The Race to Human-Level Reasoning – Global X ETFs, Your Quick Guide to Quantum and AI, Quantum Computing Valuation: Navigating the Hype and the Future – SpinQ, IBM Quantum Roadmap 2025, Roadmap – IonQ, IonQ’s Accelerated Roadmap: Turning Quantum Ambition into Reality, Quantum Technology Monitor – McKinsey, Supervised Quantum Machine Learning: A Future Outlook from Qubits to Enterprise Applications – arXiv, Quantum Computing Future – 6 Alternative Views Post 2025 – Quantum Zeitgeist, Quantum Computing – Strategic Recommendations for the Industry – arXiv, Quantum vs. classical: A comprehensive benchmark study for predicting time series with variational quantum machine learning – arXiv, Quantum Computing In Drug Discovery Market Size, Share & 2030 Growth Trends, Best Open Source LLMs 2026: DeepSeek R1 vs Llama 4 vs Qwen 3 | Local AI Master.

4. Etik, Risk Yönetimi ve Toplumsal Etki

Energy and AI – Stanford University, Energy demand from AI – Analysis – IEA, The AI-energy nexus will dictate AI’s future – WEF, ‘Roadmap’ shows the environmental impact of AI data center boom | Cornell Chronicle, U.S. Data Centers Could Consume as Much Water as 10 Million Americans by Decade’s End – Yale E360, The Environmental Impacts of AI – Policy Primer – Hugging Face, Coalition for Environmentally Sustainable Artificial Intelligence – Élysée, NVIDIA GPU architecture roadmap: CUDA to Blackwell – Patsnap, From Blackwell to Feynman: Analyzing NVIDIA’s Optics Roadmap – Counterpoint Research, The Essential Role of Open Source in Sovereign AI – Linux Foundation, Sovereign AI: pathways to strategic autonomy – IISS, An Open Door: AI Innovation in the Global South – CSIS, India’s big AI test is here: Making sovereign language models work – Fractal, Built for Bharat: How Sarvam’s New AI Models Compare to the World’s Best, Introducing the Technology Innovation Institute’s Falcon Perception, The French AI Report 2024: Building On Momentum, How will Artificial Intelligence Affect Jobs 2026-2030 | Nexford University, Educating a future workforce that will match AI disruption – WEF, Impact of AI on the 2025 Software Engineering Job Market – Sundeep Teki, The Impact of Generative AI on Job Opportunities for Junior Software Developers – Alicia Sasser Modestino, Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity – METR, AI could automate up to 26% of tasks in creative professions – UOC, The impact of GenAI on the creative industries | WEF, Artificial Intelligence Impacts on Copyright Law | RAND, Bias and fairness in AI models: Evidence from existing studies – WJAETS, Algorithmic bias in educational systems: Examining the impact of AI-driven decision making, What is the NIST AI Risk Management Framework? – SentinelOne, NIST AI Risk Management Framework: A simple guide to smarter AI governance – Diligent, NIST AI Risk Management Framework: A tl;dr – Wiz, Ethical and regulatory challenges of Generative AI in education – Frontiers, Modernizing AI Analysis in Education Contexts – Federation of American Scientists, Should AI Have Rights? The Emerging Debate on Machine Personhood – iymun.net, The Future of Personhood and the Ethics of Artificial Intelligence – IHE, AI and Personhood: An Ethical Examination of Artificial Intelligence and the Relational Ontology – AAR, Americans fear AI will do more harm than good by 2035 – WRAL.

Tartışmaya Katılın ve Geleceği Birlikte Kurgulayalım

Yapay zekanın “sohbet” aşamasından “otonom ajan” aşamasına geçtiği bu kritik eşikte, sizin iş akışlarınızdaki en büyük değişim ne oldu? Bu sistemlerin kodlama alışkanlıklarımızı ve veri yönetimi süreçlerimizi kökten değiştireceğine inanıyor musunuz?

LinkedIn: Bu makale hakkındaki profesyonel görüşlerinizi paylaşarak tartışmaya dahil olun.

X (Twitter): Anlık güncellemeler, hızlı “flood”lar ve teknoloji dünyasından canlı notlar için bizi takip edin.

YouTube: Haftalık derinlemesine analizler ve yapay zeka araçlarının uygulamalı videoları için abone olmayı unutmayın.